Wie gut sind Sie bei diesen Rätseln, bei denen man zehn Unterschiede auf zwei beinahe identischen Bildern finden muss? Also ich habe da noch nie geglänzt: Nach drei, vier offensichtlichen Unterschieden verliere ich meist die Geduld und schmeiße hin. So ähnlich ging es mir auch jetzt wieder, als ich auf der Website digger-project.com ein kleines Training unter dem Titel „Sharpen your Senses“ absolvierte, das dazu da ist, seine Sinne für gefakte Bilder und Tonaufnahmen zu schärfen. Das Training ist Teil des Projekts Digger Deepfake Detection von der Deutschen Welle, Fraunhofer und dem Athens Technology Center.

Es war erschreckend: In der Übung mit drei Stimmen, von denen zwei gefälscht sind, war ich auch nach oftmaligem Anhören aufgeschmissen – und das, obwohl ich Erfahrung mit Audio-Schnitt habe. Auch zu erkennen, ob in der Tonaufnahme einer Geräuschkulisse eine Waschmaschine, ein Aufzug oder ein Auto zu hören ist, fiel mir recht schwer. Es sind Fähigkeiten, die ich bisher nie zu brauchen glaubte. Dabei wäre die bewusste und feine Wahrnehmung, die man mit solchen Übungen trainiert, in Zeiten wie diesen sehr wichtig.

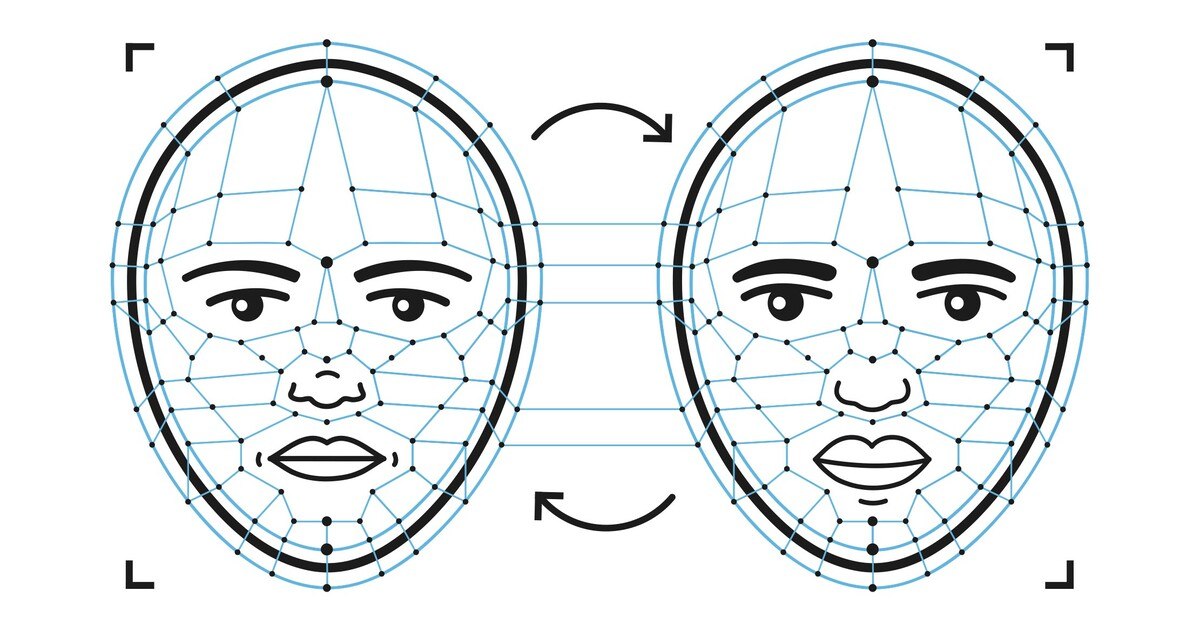

Denn es kursieren mehr und mehr gefakte Bilder, Videos und Audioaufnahmen, die noch dazu immer besser werden. Je weiter sich Machine-Learning und Künstliche Intelligenz entwickeln, desto schwerer wird es für uns Menschen, Deepfakes als digitale Fälschungen zu erkennen. Zwar sagte die ehemalige Buzzfeed-Reporterin Jane Lytvynenko in einem Interview mit Digger Ende 2020, dass Deepfakes für Menschen ohne besonderes technologisches Know-how noch immer recht schwer zu produzieren seien, doch sie fügte hinzu, dass sie sehr wohl Angst vor einem „großen“ Deepfake habe, der alle täuscht.

Es gibt vielerorts ein Interesse, Menschen, Bevölkerungsgruppen oder ganze Staaten zu täuschen oder zu verwirren, damit sie Wahrheit und Lüge nicht mehr unterscheiden können. Manchmal haben Deepfakes einen subversiven Charakter, wenn zum Beispiel der ehemalige griechische Finanzminister Yanis Varoufakis Deutschland den Stinkefinger zeigt – ein Fake des Satirikers Jan Böhmermann von 2015, der kurze Zeit Aufregung erzeugt hat. Wenn hinter Deepfakes aber keine spaßig-aufklärerischen, sondern ernste Absichten stehen, kann es brandgefährlich werden. Zum Beispiel könnte es im Ukraine-Russland-Krieg auch zu massiven Desinformationsmaßnahmen kommen: Wer weiß schon, ob das nächste Russland-Zitat von Joe Biden, das sich rasend schnell über die Medien verbreitet, kein Fake ist? Und ob nicht ein Restzweifel bleibt, selbst wenn er die Aussage von sich weist? Und natürlich steigt auch in der Wirtschaft die Wahrscheinlichkeit, dass solche Manipulationen zunehmen, weil Deepfakes immer einfacher hergestellt werden können und auch, weil Geopolitik und Wirtschaft so eng miteinander verknüpft sind. Vielleicht bekommen Sie ja schon morgen einen vermeintlichen Anruf aus der Geschäftsführung, mit dem man Ihnen einen Bären aufbinden will?

Daher: Halten wir vor allem im digitalen Raum die Augen und Ohren weit offen und gehen wir mit einer gesunden Grundskepsis an die Bilder, Videos und Botschaften heran, die von überallher auf uns hereinprasseln. Und machen wir gelegentlich ein „Zehn-Unterschiede-Rätsel“.

Zur Autorin: Alexandra Rotter berichtet von aktuellen Cyberwar-Schauplätzen, über Angreifer und deren Strategien, Schäden sowie Schutzmaßnahmen.